Загрузка предыдущей публикации...

Загрузка предыдущих новостей...

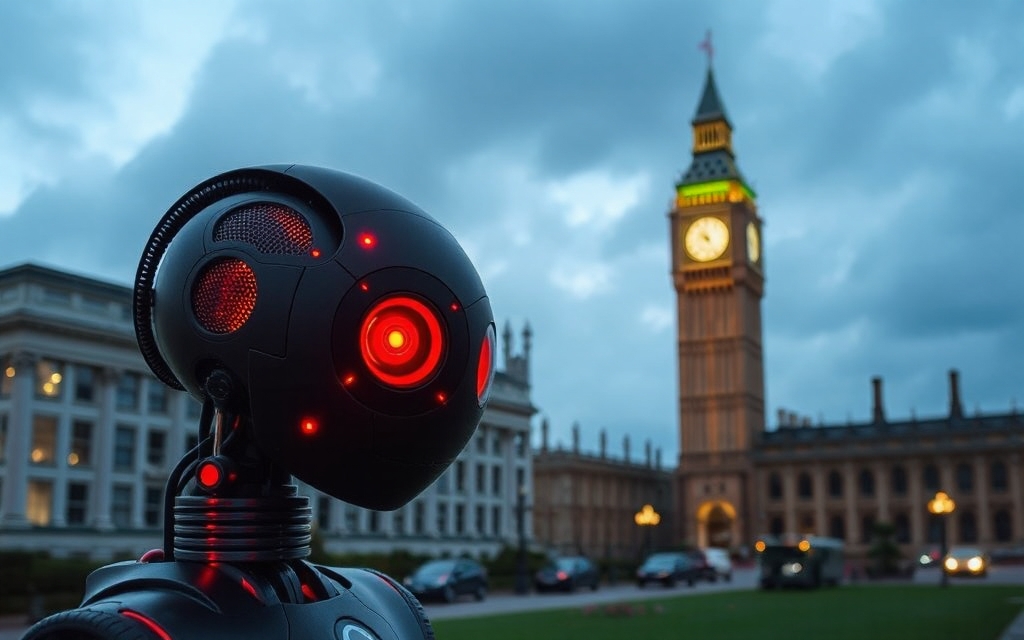

Институт Алана Тьюринга опубликовал рекомендации по защите исследований в области ИИ в Великобритании. Государственные акторы представляют серьёзную угрозу для развития искусственного интеллекта в стране, и университетам необходимо повысить уровень защиты.

В своём отчёте Институт Алана Тьюринга предупредил о необходимости «немедленных действий» для сохранения мирового лидерства Великобритании в области исследований ИИ. Отмечается, что требуется скоординированная реакция со стороны британского правительства и высших учебных заведений для разработки мер защиты научного сообщества.

В отчёте содержатся рекомендации по созданию классифицированной карты экосистемы ИИ в высшем образовании, а также предоставлению руководства университетам. Высшие учебные заведения Великобритании всё чаще становятся мишенью для угроз: почти половина из них сталкивается с кибератаками каждую неделю.

Отчёт подтверждает, что акторы, действующие от имени государств, используют «шпионаж, воровство и двойные соглашения» с целью приспособиться к развитию исследований и разработок в Великобритании. Быстрые темпы развития ИИ делают его уязвимым для государственных акторов, стремящихся украсть интеллектуальную собственность и использовать её с негативными целями.

Выражены опасения по поводу доступа недружественных стран к «двумяцелевому» характеру технологий ИИ. Это означает, что технологии могут быть переосмыслены или развернуты для использования в злонамеренных целях — например, оборонные инструменты могут быть использованы для атак.

Отчёт подчеркивает необходимость изменений культуры с акцентом на повышение осведомлённости о рисках и обеспечение соблюдения руководящих принципов. Для закрытия «дыр» в специалистах по ИИ предлагается удерживать внутренние кадры и предоставлять обучающие программы по безопасности исследований для сотрудников и студентов.

Учёные также рекомендуют учредить комитеты прозрачности исследований, чтобы поддерживать оценку рисков для специалистов в области ИИ. Развитие исследования ИИ — это важнейшая задача для Великобритании, но связанные с ним угрозы безопасности не могут быть проигнорированы по мере того как окружающий нас мир становится всё более нестабильным

, — говорит Меган Хьюджес (Megan Hughes), исследовательский сотрудник Института Алана Тьюринга. «Университетам и правительству необходимо внести долгожданные изменения культуры, чтобы обеспечить правильный баланс между академической свободой и защитой этого важного ресурса».

Загрузка предыдущей публикации...

Загрузка следующей публикации...

Загрузка предыдущих новостей...

Загрузка следующих новостей...